Оптимизация приложений Azure OpenAI с помощью семантического кэширования

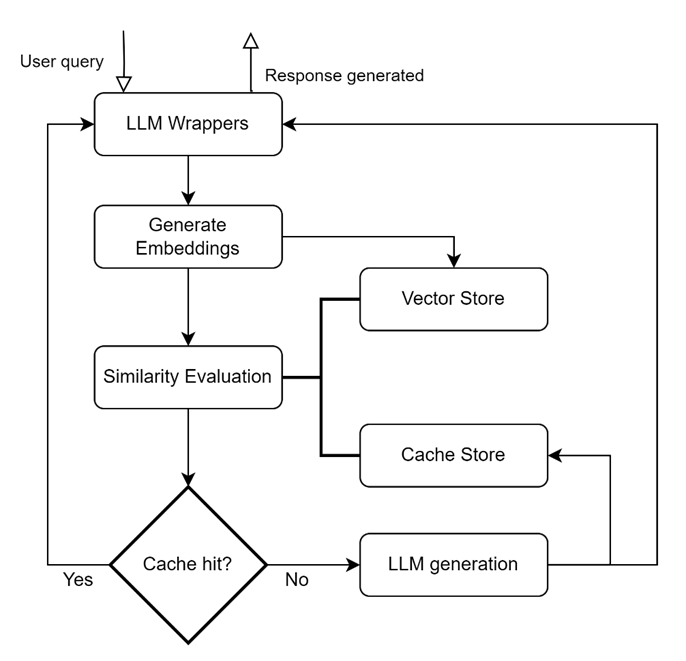

Введение Одним из способов оптимизации стоимости и производительности моделей большого языка (LLM) является кэширование ответов от LLM, иногда это называют «семантическим кэшированием». В этом блоге мы обсудим подходы, преимущества, распространенные сценарии и ключевые соображения по использованию семантического кэширования. Что такое семантическое кэширование? Системы кэширования обычно сохраняют часто извлекаемые данные для последующего обслуживания оптимальным образом. В … Read more